Las herramientas de inteligencia artificial (IA) generativa están aquí, al igual que el potencial infinito para su uso indebido. Podrían fabricar información errónea durante las elecciones. Rutinariamente inventan información sesgada e incorrecta. Además, hacen que sea extremadamente fácil hacer trampa en las tareas de ensayo en la escuela.

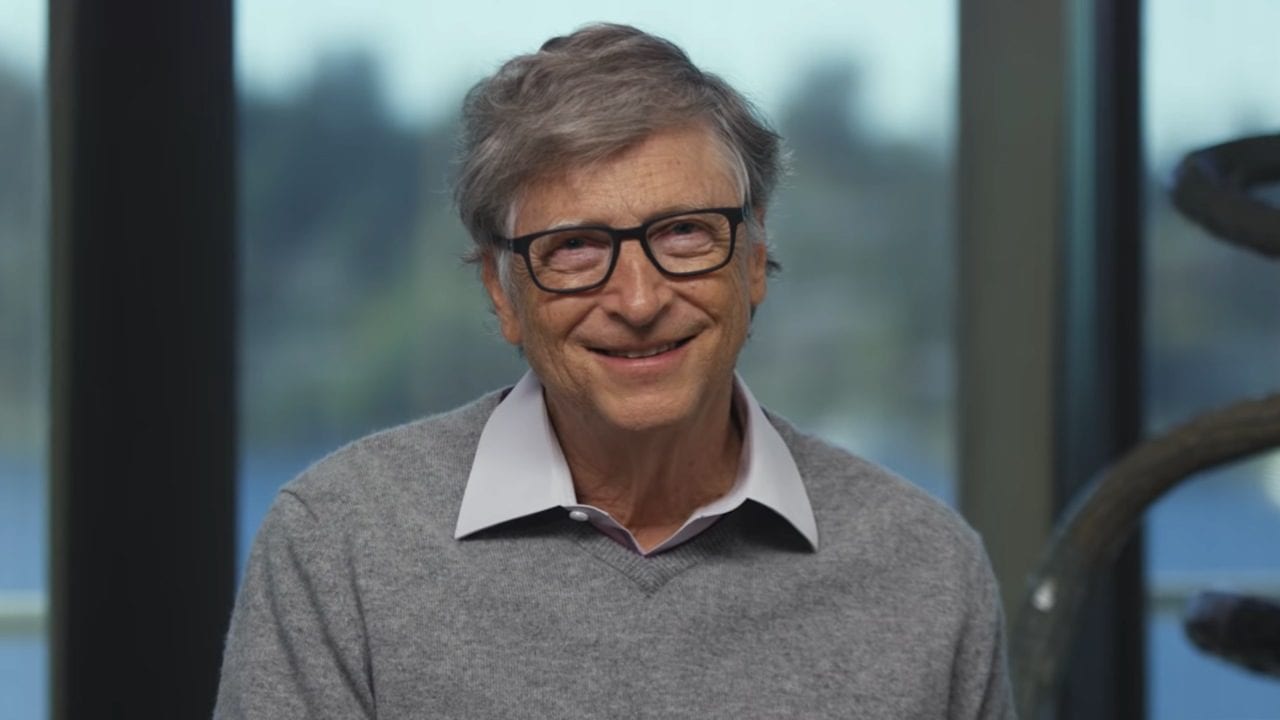

El multimillonario Bill Gates, quien le dijo a Forbes a principios de este año que cree que el cambio a la IA es “tan importante como la PC”, está preocupado por todos estos desafíos. Pero por cómo habló en una publicación de blog reciente, él cree que la IA se puede usar para abordar los problemas que ha creado.

Uno de los problemas más conocidos con los grandes modelos de lenguaje es su tendencia a “alucinar” o producir información objetivamente incorrecta y sesgada o dañina. Esto se debe a que los modelos se entrenan con una gran cantidad de datos recopilados de internet, que está plagado de sesgos y desinformación. Pero Gates cree que es posible construir herramientas de IA que sean conscientes de los datos defectuosos en los que están entrenados y las suposiciones sesgadas que hacen.

“Los modelos de IA heredan los prejuicios que están integrados en el texto en el que están capacitados”, escribió. “Soy optimista de que, con el tiempo, se pueda enseñar a los modelos de IA a distinguir la realidad de la ficción. Un enfoque es construir valores humanos y un razonamiento de alto nivel en la IA”.

En ese sentido, destacó los intentos del creador de ChatGPT, OpenAI, de hacer que sus modelos sean más precisos, representativos y seguros a través de la retroalimentación humana. Pero el chatbot viral está plagado de sesgos e inexactitudes incluso después de entrenarlo en una versión avanzada de su modelo de lenguaje grande, GPT-4.

Los investigadores de AI descubrieron que ChatGPT refuerza los estereotipos de género sobre los trabajos de mujeres y hombres. Los chatbots más nuevos, como el bot rival ChatGPT de Anthropic, Claude 2.0, también están tratando de mejorar la precisión y mitigar el contenido dañino, pero aún no han sido probados ampliamente por los usuarios.

Gates tiene una razón para hablar de ChatGPT: su empresa, Microsoft, ha invertido miles de millones de dólares (mdd) en OpenAI. A fines de abril, su riqueza aumentó en 2 mil millones de dólares después de que la llamada de ganancias de Microsoft mencionara la IA más de 50 veces. Actualmente está valorado en alrededor de 118 mil mdd.

Lee también: Inteligencia artificial sustituirá los sitios de búsqueda y compra, prevé Bill Gates

Un ejemplo que Gates discutió en su blog es cómo los hacekrs y los ciberdelincuentes están utilizando herramientas generativas de IA para escribir código o crear voces generadas por IA para ejecutar estafas telefónicas.

Estos impactos fuera de control de las herramientas llevaron a algunos líderes y expertos en IA, incluido el cofundador de Apple, Steve Wozniak, Tesla, SpaceX y el CEO de Twitter, Elon Musk, y el cofundador del Centro de Tecnología Humana, Tristan Harris, a pedir una pausa en el despliegue de poderosas herramientas de IA en una carta abierta publicada a fines de marzo.

Gates rechazó la carta y enfatizó que no cree que una pausa en los desarrollos resuelva ningún desafío. “No deberíamos tratar de evitar temporalmente que las personas implementen nuevos desarrollos en IA, como han propuesto algunos”, escribió.

En cambio, dijo que estas consecuencias ofrecen más razones para continuar desarrollando herramientas avanzadas de IA, así como regulaciones para que los gobiernos y las corporaciones puedan detectar, restringir y contrarrestar los usos indebidos de la IA. “Los ciberdelincuentes no dejarán de fabricar nuevas herramientas… El esfuerzo por detenerlos debe continuar al mismo ritmo”, escribió.

Pero la afirmación de Gates de que las herramientas de IA se pueden usar para combatir las deficiencias de otras herramientas de IA, puede que prácticamente no se sostenga, al menos no todavía. Por ejemplo, si bien se ha lanzado una gama de detectores de IA y detectores de falsificación profunda, no todos siempre pueden marcar correctamente el contenido sintético o manipulado. Algunos representan incorrectamente imágenes reales como generadas por IA, según un informe del New York Times. Pero la IA generativa, que aún es una tecnología incipiente, debe ser monitoreada y regulada por agencias gubernamentales y empresas para controlar sus efectos no deseados en la sociedad, dijo Gates.

“Ahora estamos en… la era de la IA. Es análogo a los tiempos inciertos antes de los límites de velocidad y los cinturones de seguridad”, apuntó Gates.

Esta nota fue publicada originalmente en Forbes US

¡Ya estamos en Threads! Síguenos para recibir la mejor información